L’anno scorso Hollywood ha fatto il punto sul potenziale – e sui pericoli – dell’intelligenza artificiale generativa (IA). Quando l’uso dei chatbot che imitano gli umani si è trasformato in un punto critico negli scioperi, i creatori sono ricorsi ai tribunali, accusando le aziende di IA di violazioni del copyright su larga scala, dopo che le loro opere erano state presumibilmente utilizzate come materiale di addestramento. Sullo sfondo di queste battaglie legali, spicca una domanda: perché i grandi Studios non hanno fatto causa per proteggere la loro proprietà intellettuale come altri detentori di diritti?

Una risposta riguarda la possibilità che stiano ancora negoziando con le aziende di IA, con l’obiettivo di trovare un accordo di licenza. Un’ipotesi più cupa è che vogliano sfruttare gli strumenti per ridurre i costi di lavoro. Un’altra ipotesi è che stiano aspettando il momento giusto per raccogliere prove e tenere d’occhio l’andamento degli altri casi.

Thanos e Tom Cruise secondo l’IA

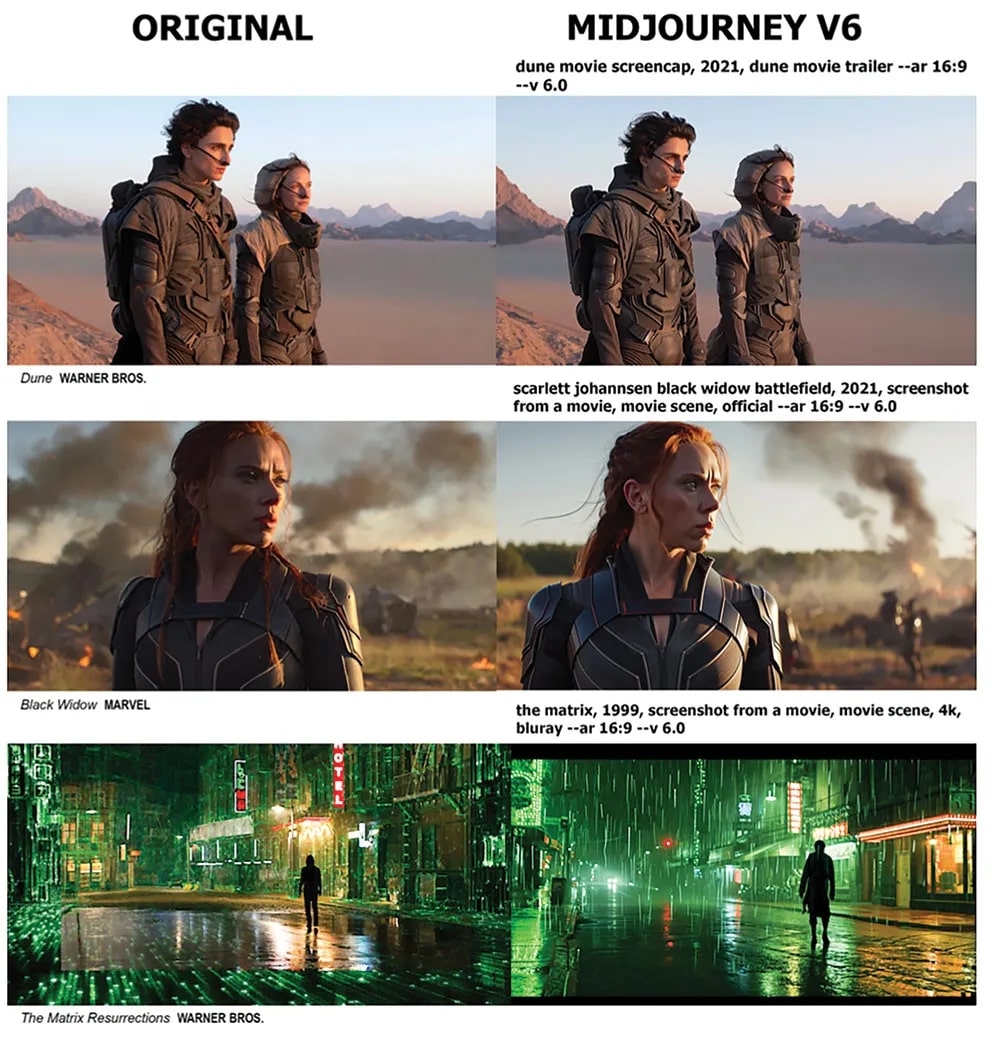

Gli Studios potrebbero ora avere la prova che gli serve per scendere in campo, con i generatori di immagini IA che restituiscono sempre più spesso repliche quasi esatte di fotogrammi di film. Usando il prompt “Thanos Infinity War”, Midjourney – un programma di intelligenza artificiale che traduce il testo in immagini iperrealistiche – restituisce un’immagine del cattivo dalla pelle viola in un fotogramma che sembra tratto dal film Marvel o dal materiale promozionale, con poche o nessuna alterazione.

Un’inquadratura di Tom Cruise nella cabina di pilotaggio di un caccia, tratta da Top Gun: Maverick, viene prodotta in modo simile se si chiede allo strumento un fotogramma del film. I chatbot sono apparentemente in grado di replicare quasi ogni stile di animazione, generando personaggi sorprendentemente accurati da titoli che vanno da Shrek della DreamWorks a Ratatouille della Pixar fino a The Lego Movie della Warner Bros.

Non è difficile immaginare un futuro in cui alcuni spettatori rinuncino alla visione di film tradizionali a favore della creazione di titoli propri utilizzando strumenti di intelligenza artificiale, che prendono in prestito in larga misura la proprietà intellettuale degli Studios.

Questi risultati sono illustrati in uno studio del 6 gennaio del ricercatore di IA Gary Marcus e del concept artist Reid Southen, che ha lavorato a Hunger Games, Transformers – L’ultimo cavaliere e The Woman King. “Quello che abbiamo dimostrato è che probabilmente ci saranno molte più cause legali in ambito visivo”, afferma Marcus. “Si tratta essenzialmente di duplicazioni di proprietà senza alcun tipo di attribuzione”.

Fotogrammi di film a confronto con le “creazioni” dell’IA Midjourney realizzate su richiesta dei ricercatori. (Courtesy of Gary Marcus and Reid Southen)

Una probabile violazione di copyright

Secondo gli esperti legali consultati da The Hollywood Reporter, i risultati suggeriscono che per addestrare i modelli di intelligenza artificiale sono stati utilizzati interi film o, come minimo, trailer e fotogrammi promozionali. Affermano che gli Studios e le case di produzione avrebbero le basi per un’azione legale convincente per violazione del copyright. “L’unico modo per ottenere queste immagini è ingerire almeno una parte del film”, afferma Justin Nelson, un avvocato specializzato in proprietà intellettuale che rappresenta degli scrittori di narrativa in una causa contro OpenAI e Microsoft. “Se fossi uno studio e il proprietario di questa proprietà intellettuale, sarei già al telefono con i miei avvocati per cercare di capire quali sono i miei diritti”.

Sarah Odenkirk, avvocata specializzata in proprietà intellettuale e socia della Cowan DeBaets, sottolinea: “È chiaro che questo implica che intere opere vengono utilizzate all’ingrosso senza autorizzazione”. Aggiunge Scott Sholder, avvocato specializzato in proprietà intellettuale che rappresenta la Authors Guild in una causa contro OpenAI: “Questo mi dice che per addestrare i modelli sono stati utilizzati materiali protetti da copyright e che non ci sono paletti sufficienti per impedire la produzione di contenuti in violazione”.

Le IA, scatole nere

Tuttavia, le cause esistenti hanno arrancato nelle prime fasi del contenzioso. I modelli di IA sono scatole nere. Questa è una caratteristica, non un bug (OpenAI ha smesso di divulgare informazioni sulle fonti dei suoi set di dati dopo essere stata citata in giudizio).

Dato che il contenuto dei materiali di addestramento rimane in gran parte sconosciuto al pubblico, non c’è una “pistola fumante” che provi che un lavoro specifico sia stato utilizzato per la creazione di un chatbot.

L’unica prova che i querelanti possono produrre è una risposta generata da un chatbot che sia identica all’opera di cui si sospetta la violazione. La Authors Guild, nella sua causa contro OpenAI, ha indicato come prova che OpenAI si è addestrato sui loro libri il fatto che ChatGPT produce riassunti e analisi approfondite dei temi dei loro romanzi.

La difficoltà

La questione è stata segnalata da diversi tribunali. In un’ordinanza che respingeva le richieste di risarcimento per violazione di copyright nei confronti di Midjourney e DeviantArt, un giudice federale ha dichiarato in ottobre che gli artisti dovranno probabilmente dimostrare l’esistenza di opere in violazione del copyright identiche al materiale presumibilmente utilizzato come materiale di addestramento. Ciò rappresenta potenzialmente un problema notevole, poiché gli artisti hanno ammesso che “è probabile che nessuna delle immagini di output di Stable Diffusion fornite in risposta a un particolare prompt testuale corrisponda a un’immagine specifica nei dati di addestramento”.

Anche la causa intentata da Sarah Silverman contro Meta è stata respinta, in quanto non è stata fornita la prova che uno qualsiasi degli output “possa essere inteso come un rifacimento, una trasformazione o un adattamento dei libri della querelante”, secondo la sentenza del giudice distrettuale degli Stati Uniti Vince Chhabria.

“È un cane che si morde la coda”, afferma il direttore generale della Recording Industry Association of America, Mitch Glazier. “Non è possibile presentare una richiesta di risarcimento se non si dispone di prove, ma non è possibile ottenere informazioni finché non si presenta una richiesta di risarcimento. Abbiamo bisogno di una sorta di processo, prima di una causa, per verificare se il materiale è stato copiato”.

Il caso New York Times

La preoccupazione per la difficoltà di produrre tali prove è uno dei motivi per cui la causa intentata dal New York Times contro OpenAI e Microsoft è così importante. La causa ha presentato ampie prove di strumenti di queste aziende che, quando sollecitati con prompt adeguati, visualizzano estratti di articoli quasi parola per parola, consentendo agli utenti di aggirare il paywall e rendendo potenzialmente questi servizi dei concorrenti del Times. Queste risposte, secondo la causa, vanno ben oltre i frammenti di testo tipicamente mostrati nei normali risultati di ricerca.

Un esempio tra gli oltre 100 forniti nella denuncia: Bing Chat ha copiato tutte le prime 396 parole, tranne due, del suo articolo del 2023 “The Secrets Hamas knew about Israel’s Military.” (“I segreti che Hamas conosceva sull’esercito di Israele”).

Midjourney sembra aver preso talmente atto del problema, che la sua ultima versione, rilasciata il 21 dicembre, non rimescola più le immagini e le figure in modo da nascondere quella che, secondo gli esperti legali, è una chiara violazione del copyright. Dopo che Southen, il 21 dicembre, è intervenuto sui social media per segnalare le sue scoperte, l’azienda ha bannato il suo account.

Una ricerca sulla Wayback Machine di Internet Archive mostra che l’azienda ha inserito nei suoi termini che gli utenti “non possono utilizzare il Servizio per cercare di violare i diritti di proprietà intellettuale di altri”. Una parte dei termini afferma che Midjourney citerà in giudizio gli utenti se dovrà affrontare azioni legali derivanti da utenti che “consapevolmente” violano materiale protetto da copyright.

Trovare accordi sull’IA

Tuttavia, tra i problemi legati all’attribuzione della responsabilità finale ai consumatori c’è il fatto che probabilmente questi ultimi non si accorgeranno quando i chatbot produrranno contenuti che violano la legge. Tutti conoscono Mario e Luigi; non altrettanti conoscono la fotografia di paesaggi culturali di Joo Myung Duck.

Se fanno causa, i grandi Studios potrebbero costringere le aziende di IA a sedersi al tavolo delle trattative per ottenere un vantaggio. La maggior parte dei creatori che hanno già fatto causa ha segnalato di essere disposta ad accettare accordi di licenza. La Authors Guild si sta muovendo in questa direzione, con l’intenzione di presentare una piattaforma che consenta ai suoi membri di optare per l’offerta di una licenza globale. Le discussioni riguardano una tassa per l’utilizzo delle opere come dati per l’addestramento e il divieto di produrre materiale che si avvicini troppo a quello esistente. “Dobbiamo essere proattivi perché l’IA generativa è destinata a restare”, afferma Mary Rasenberger, dirigente dell’organizzazione, che fa notare come l’autore di best seller James Patterson abbia contribuito a finanziare il progetto. “Hanno bisogno di libri di alta qualità. La nostra posizione è che non c’è nulla di sbagliato nella tecnologia, ma deve essere legale e autorizzata”.

Nel frattempo, mentre i tribunali sono alle prese con questioni inedite di diritto d’autore, i concept artist come Southen vedono diminuire il mercato per i loro servizi, poiché sono sempre più costretti a competere con i chatbot che hanno involontariamente contribuito a creare.

“Gli affari quest’anno sono andati malissimo”, racconta Southen. “So che ci sono stati gli scioperi, ma c’è sicuramente dell’altro”.

Traduzione di Nadia Cazzaniga

THR Newsletter

Iscriviti per ricevere via email tutti gli aggiornamenti e le notizie di THR Roma